Composer 2 기술 보고서

에이전트형 소프트웨어 엔지니어링을 위한 코딩 모델인 Composer 2의 학습에 관한 기술 보고서를 arXiv에 게시했습니다.

이 보고서는 오픈 기본 모델인 Kimi K2.5 기반의 후속 사전학습부터 대규모 강화학습까지의 전체 학습 과정을 다루며, 실제 Cursor 환경을 최대한 가깝게 재현하는 데 초점을 맞춥니다.

후속 사전학습과 RL

Composer 2는 두 단계로 학습됩니다. 먼저 기본 모델의 코딩 지식을 심화하기 위해 코드 중심의 데이터 혼합으로 후속 사전학습을 수행한 뒤, 종단 간 에이전트 성능을 높이기 위해 대규모 강화학습을 진행합니다. 사전학습 손실을 낮추면 다운스트림 RL 성능이 향상되며, 더 나은 기본 지식이 안정적으로 더 뛰어난 에이전트 성능으로 이어진다는 점을 확인했습니다.

Composer 2의 RL 학습은 배포된 모델이 사용하는 것과 동일한 도구와 하네스를 갖춘 실제 Cursor 세션에서 이루어지며, 개발자가 Composer에 요청하는 작업의 전체 범위를 반영한 문제 분포에 적용됩니다. RL 학습은 평균 성능과 best-of-K 성능을 모두 향상시키며, 이는 모델이 이미 알려진 해법에만 집중하는 것이 아니라 새로운 해결 경로를 학습하고 있음을 시사합니다.

CursorBench를 통한 실제 환경 평가

코딩 모델을 만들 때의 핵심 과제는 공개 벤치마크가 개발자가 실제로 하는 일을 제대로 반영하지 못하는 경우가 많다는 점입니다. 작업은 지나치게 구체적으로 정해져 있고, 해결 방식은 제한적이며, 코드베이스도 작습니다.

저희는 엔지니어링 팀의 실제 코딩 세션을 바탕으로 CursorBench를 만들었습니다. 여기에는 프롬프트가 짧고 모호하며, 여러 파일에 걸쳐 수백 줄의 변경이 필요한 작업이 포함됩니다. 저희는 학습과 평가 전반에 걸쳐 CursorBench를 사용해 모델이 실제 과제에 맞게 정렬되도록 합니다.

성능

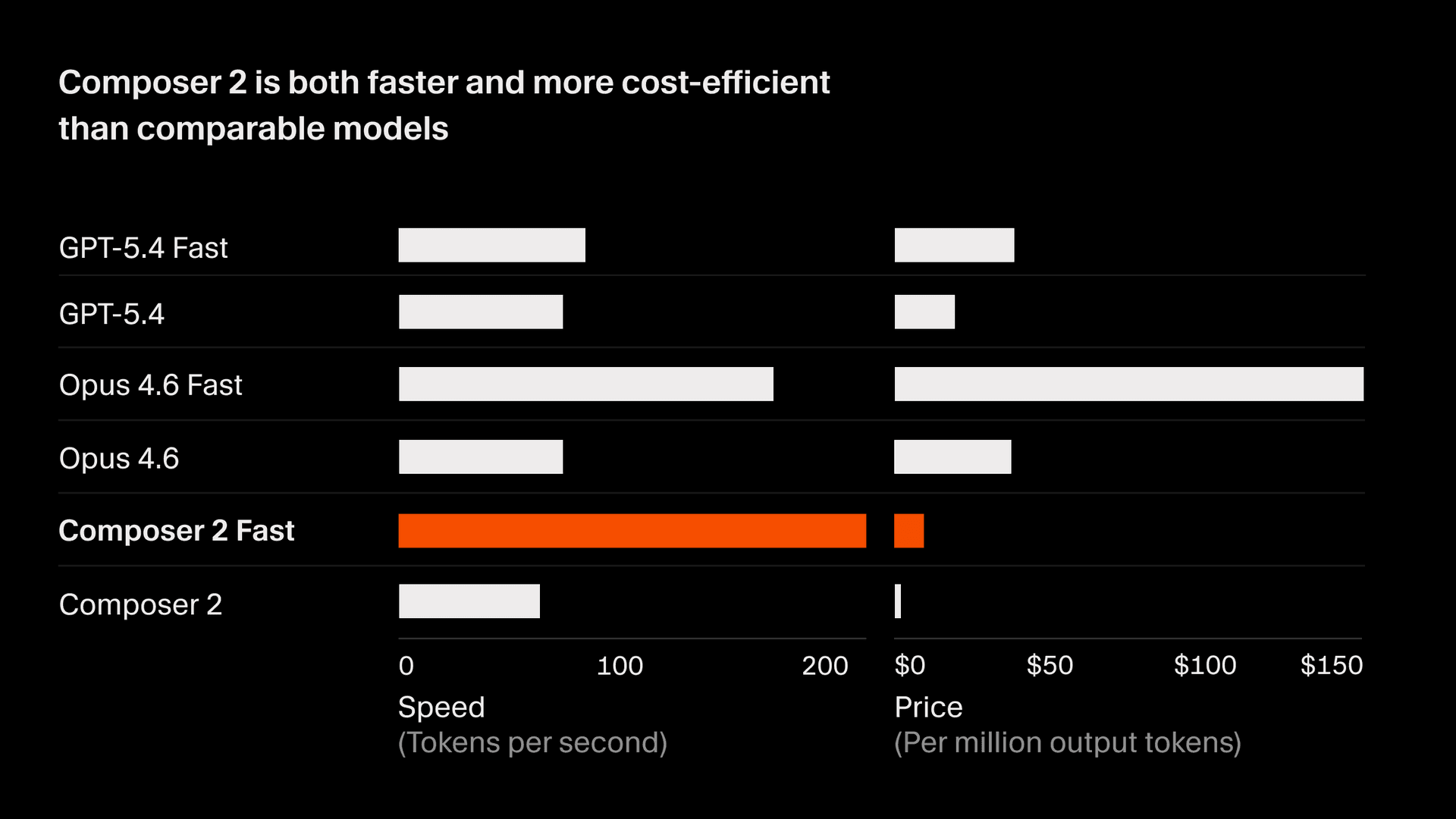

CursorBench에서 Composer 2는 61.3점을 기록해 Composer 1.5 대비 37% 개선되었으며, 가장 강력한 프런티어 모델과 견줄 만한 수준입니다. 공개 벤치마크에서는 SWE-bench Multilingual에서 73.7점, Terminal-Bench에서 61.7점을 기록했습니다. 또한 비슷한 모델보다 훨씬 낮은 추론 요금으로 이러한 성능을 달성해, 대화형 개발자 워크플로우에서 정확도와 요금 사이의 파레토 최적 균형을 제공합니다.

인프라

Composer 2 학습에는 Blackwell GPU에서 효율적인 MoE 학습을 위한 맞춤형 저정밀도 커널, 여러 리전에 걸친 완전 비동기식 RL 파이프라인, 그리고 수십만 개의 격리된 코딩 환경을 실행하기 위한 당사 내부 컴퓨트 플랫폼 Anyrun을 포함한 대규모 인프라 개발이 필요했습니다. 이 보고서에서는 가중치 동기화, 장애 허용, 환경 충실도에 대한 당사의 접근 방식을 포함해 전체 스택 전반을 다룹니다.

이 보고서에는 학습 레시피에 대한 어블레이션 결과, 에이전트 행동을 조정하는 방식, 평가 스위트 설계 등 이 모든 내용에 대한 훨씬 더 자세한 설명이 담겨 있습니다.

Kimi K2.5, Ray, ThunderKittens, PyTorch, 그리고 더 넓은 오픈소스 커뮤니티의 팀들께 감사드립니다. 또한 Fireworks와 Colfax의 협업과 파트너십에도 감사드립니다.

전체 기술 보고서는 여기에서 읽어보세요.